今年苹果的 iPhone12旗舰机型上面搭载了激光雷达。很多人其实都听说过激光雷达,苹果的发布会上也提了这个东西,但是其实我发现很多人都不了解这个东西到底是怎么回事。

所以,我今天就想从头从原理里,给大家讲清楚激光雷达是什么东西。以及它到底有什么用处。给大家讲明白,为什么苹果会在旗舰机型上放这么一个东西,以及这个东西对我们的未来、对这个世界有什么改变。

首先来说,我们要聊一聊什么是激光雷达,Wiki上面的介绍是这样的:

光学雷达(英语LiDAR,是“light detection and ranging”的缩写),是一种光学遥感技术,它通过向目标照射一束光,通常是一束脉冲激光来测量目标的距离等参数。激光雷达在测绘学、考古学、地理学、地貌、地震、林业、遥感以及大气物理等领域都有应用。此外,这项技术还用于机载激光地图测绘、激光测高、激光雷达等高线绘制等等具体应用中。光学雷达对物体距离的测量与通常所说的雷达类似,都是通过测量发送和接受到的脉冲信号的时间间隔来计算物体的距离。因此,由于原理上的相似性,尽管雷达的准确定义是使用微波或无线电波等波长较长的电磁波进行检测测距的设备,光学雷达这一术语仍然被广泛使用。

Wiki

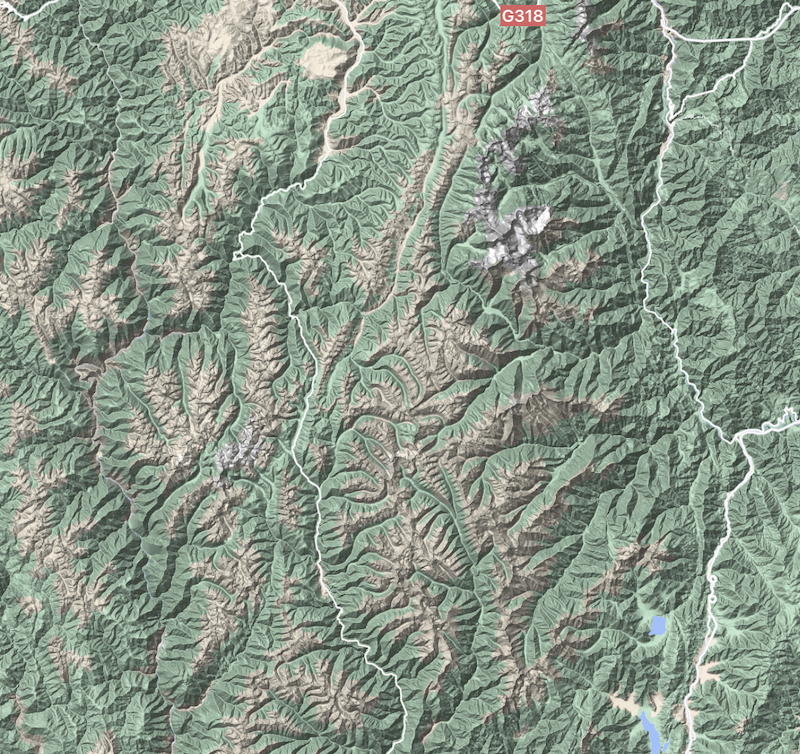

这个技术最早就是用在遥感上面,跟我们普通人感觉距离很远,其实Google地图上啊,一些别的地图上的地形图,可以看到地面高低起伏,山峦河流的高低的那种地形图,其实很多就是用激光雷达来测量绘制出来的。

这种是用卫星或者是用飞机、无人机、直升机之类的搭载高功率的激光雷达从天上往下扫描得到的。

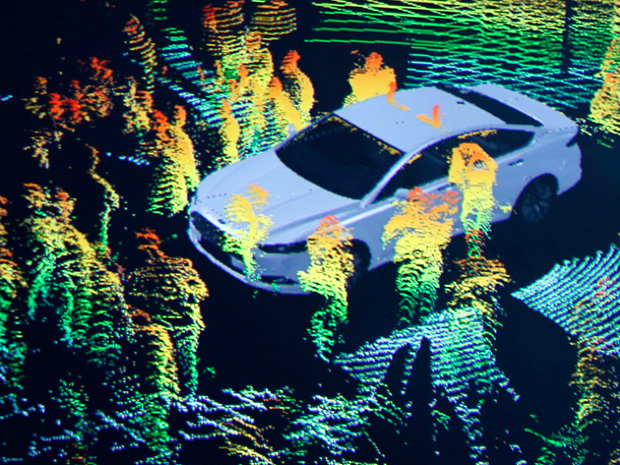

更多人听说的激光雷达最早是在各种自动驾驶车辆上。汽车装配了激光雷达以后,就可以获得一些视觉上无法获得信息,得到周围物体的3D模型,更好的帮助自动驾驶,防止出现事故等等。

那么手机上的激光雷达是什么样子呢?

iPhone 12 Pro Max三个摄像头下方的这个大黑点,就是激光雷达。

它是怎么工作的呢?

我给大家看一段演示,

这个是拿着iPad Pro演示的,iPad Pro的激光雷达和iPhone 12 Pro系列的激光雷达是一样的。实际上激光雷达的工作方式就是这个传感器会发射出很多束红外激光(人眼不可见,这种演示是用红外感光的摄像机拍摄的),在平面上,物体表面上形成很多的脉冲光点,摄像头捕捉到这个光点的时间就可以知道这些光点,也就是物体的表面距离这个激光雷达的距离。有了这些距离信息,我们就可以计算物体表面的3D模型。

那么实际上有的人可能知道,现在有很多安卓手机,内置了一种TOF(Time-of-flight)传感器,它也可以做3D建模。那么TOF和激光雷达的区别在哪里呢?

大家可以看一下这个比较,上面仍旧是iPad Pro的激光雷达,下面是三星的TOF传感器:

简单的说,TOF传感器发射的是一束扩散的光,所以它可能不是激光,所以 你看到的是一个巨大的光点,而激光雷达,你看到的是一组光点的矩阵。

这两个的主要区别是什么呢?他们都是在算光打到物体表面以后发射回来的时间,这样就得到当前物体的表面各个部分和镜头之间的距离。但是安卓上使用的这种TOF的精度比较低,成本也比较低。因为它只打一束光,而且应该不是激光,因为它可以扩散成一个大光斑。而激光雷达必须是激光,激光才能保证不管多远,它都是直的,不扩散。而且激光雷达需要多束光,具体的技术细节我也没跟踪,但是这么小的部件应该不是靠旋转运动部件来生成多个光电脉冲。应该不包含任何的可动部件。但是总之它的成本就会更高一些。

但是苹果用了更高成本的激光雷达,它也能获得更高的精确度和稳定性。

这就是激光雷达的一个基本原理。

然后我们看激光雷达到底能干什么呢?

我使用了一个,苹果自己的ARKit的3D场景重现的demo,来给大家演示。

这个Demo的名字叫做Visualizing and Interacting with a Reconstructed Scene,你可以在苹果开发者网站下载这个代码,如果你会iOS开发的话,可以自己下载,在自己的iPhone 12 Pro / Pro max或者iPad Pro上测试,其他没有激光雷达的机器,这个App跑不了。

这个场景就是我家,你可以看得很清楚,在我家的所有家具物品上面,都蒙着一层小网格。这些网格其实就是iPhone通过激光雷达和图像对我家的3D实景实时模型。

如果你会安装这个Demo App到你的手机的话,在玩这个APP的时候,你可以试一试,把用手指把激光雷达遮住,你就会发现马上它的实时建模能力就消失了。原有的模型线框还在,但是新的实时建模就没法做了。

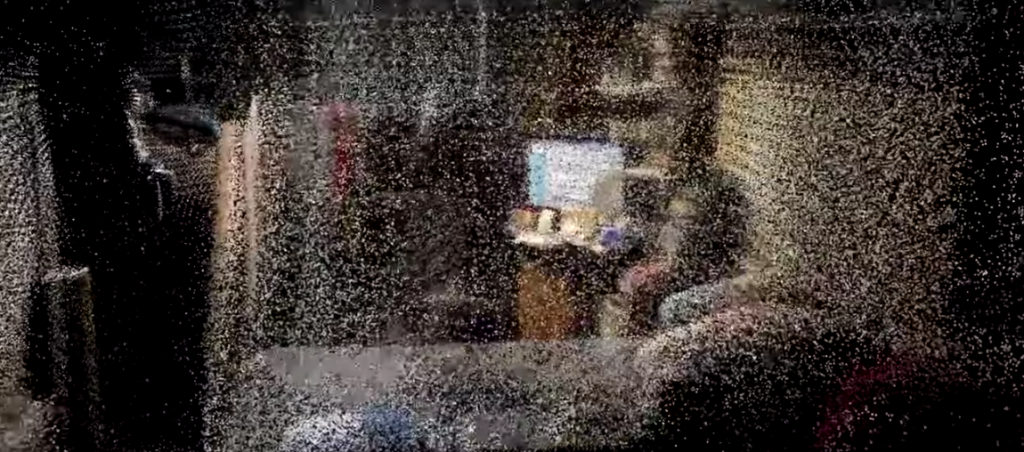

你还可以看看点云的例子,这个例子叫Visualizing a Point Cloud Using Scene Depth。

这个例子,我就不放视频了。点云是另外一种描述三维空间的方式,原理其实跟上一个Demo是一个意思。但是表达方式不同。下图是透过卧室的窗帘看我的卧室的3D点云。

简单的说,如果你想开发一个程序,你需要能感知和对周围环境建模,你就需要激光雷达。

那么激光雷达能干什么呢?

首先是,可以增强拍照的效果。

其实在苹果的发布会里头,就已经做了说明。激光雷达能提高摄像头的精确度,能减少聚焦的时间。特别是在夜景模式下,激光雷达可以让聚焦时间快6倍。

苹果还演示了一个,拍摄出来的效果:

我们可以发现虽然明显是夜景,但是看着很明亮,聚焦也很清楚,细节也很清楚,而且背景虚化也非常准确。

激光雷达,还可以大大提高AR游戏的效果。

那么我们首先还是来看一个Demo,我们先不去玩AR游戏。

这个Demo是用iPhone 12 Prox Max和iPhone X对比了一下ARKit老版本就有在实景中寻找平面,比如桌子的一个Demo。一般来说,现在的AR游戏都是先在实景空间里面寻找一个平面比如桌子,然后把游戏场景放在这个平面上,这样就得到了一个身临其境的感觉,比如一场世纪大战发生在你家客厅的餐桌上。

那么这个Demo叫做,Tracking and Visualizing Planes。

下图就是这个Demo,左边是我的iPhone 12 Pro Max,右边是我的iPhone X。

明显看得出来,iPhone 12 Pro Max对周围环境的建模和感知能力比iPhone X强得多。

我们再进入到一个真实的游戏的例子,这个游戏是Angry Bird VR。我觉得这是目前最好玩的一个AR/VR游戏。

首先我可以把这个游戏场景,布置在我的床上。如果看了刚才的例子会发现,如果你用iPhone X的话,床是有可能不会被识别为平面的。但是用iPhone12 Pro Max,就可以成功识别成平面。

这样的AR游戏的好处是,它有一种很奇特的场景感。就跟你玩积木一样,积木可以在桌子上玩,可以在床上玩,也可以在地上玩,可以跟家里的摆设家具产生互动。但是一般的游戏不行,只能在一个虚拟的背景下玩。而这种AR游戏就可以产生更好的更奇妙的场景感。

而激光雷达不仅仅可以寻找到更多的平面,让你的AR游戏更好布局,其实还可以让游戏更好的理解周围的环境,当然未来可能有更多游戏可以让你感受到有激光雷达和没有激光雷达完全不同的游戏效果。仅就现在的游戏来说,已经有很大的改善了。

再下来,激光雷达可以对物体甚至房屋进行3D扫描。

你扫描你的房屋,也可以扫描小的东西,比如手办。你可以扫描了房屋以后,进行装修的模拟,进行一些改造的预演。你也可以扫描一个现有的手办,再3D打印出来,或者用3D设计软件改造,来打造一个你独一无二的手板设计,然后再打印出来。

今天我只想说说房屋扫描的例子。国内有一家比较著名的房地产网站叫做链家。链家网站上,只要是有带有这个图标的房源,都是有VR实景的房源。

大家可以在链家网站和App上试试看,这种带AR实景的房源你可以点进去,随意拖拽,看每个房间每个角落的情况。还可以直接看这个房屋的3D模型。

非常方便,这就几乎可以完美的代替实地看房,可以传达的信息量远远大于房屋的照片。甚至我一度拿这个当做游戏去看不同的区域上海的房子的内部布局,比如原法租界区域的民国时代的老房子的内部装修现在是什么样子的。一些新的高档公寓的内部是怎么样的,等等。甚至里面还包括一些历史建筑,有些还是住人的,也有出租和买卖的需求。

那么链家是怎么做这种VR房源的呢?链家有一套VR扫描设备,这是一套非常专业的设备。

当然,链家开发了一系列简化的设备。但是,不管是这个比较专业的设备,还是比较轻量级的这些扫描设备。都有一个问题,因为是专业设备,一般人不会用,扫描完了也不知道怎么处理。

所以链家还有一套流程:

就是你要现在线上下单,然后约时间,然后专业人士来帮你拍摄,然后生成了结果,然后你想卖的房子才会有VR信息。这个流程就比较复杂了,需要房主或者是房屋中介和链家做很多沟通的工作。

但是现在有了激光雷达,有一些免费App的扫描效果已经相当不错了。比如我就很推荐一个叫做3D scanner App的App。

用它哪怕是普通人也可以把自己的房子给数字化,VR化,3D建模。这个App的好处不仅在于免费,而且它支持各种3D格式的导出,我也听到一些专业做装修、设计的朋友在用这个App,对他们的工作有很大的帮助,下面是我录的一个Demo视频:

这个App的扫描效果非常好。它的扫描方法也很简单,你开始扫描以后,你看到这种有紫色覆盖的区域就代表这个区域已经被扫描了。你要做的事情只是把房屋中间每一个区域,都让它变成紫色。

你可以从各个角度去扫描,你扫描过的角度就会出现在最后的模型里面。

再也不需要专业设备,一台手机就可以了,也不需要专业的人和软件去做后续的处理。

专业的扫描方式是有专业人员把专业机器架在某个位置,按个按钮,它会自动转圈,然后得到数据。然后专业人员再找另外一个关键的点,架设计器,它在自动扫描。一个房子可能要架设6-7次。

得到这些数据后,需要带回到公司让专业人士去做处理,聚合在一起才形成一个房屋的数据。

而这个App不要你有任何的专业知识,就玩游戏一样,你只要最后把让紫色覆盖屋子的全部区域就可以了。所有的数据处理都是App就可以完成的。

这就可能会催生各种各样的商业模式,以后也许任何卖东西的网站,都可以提供商品的3D模型,不仅仅是照片。房屋中介网站,短租网站Airbnb之类都可以提供房子的3D模型。毕竟只需要商品的提供者,房主自己就可以做3D模型了,不要请专业的人来帮忙扫描了。

这绝对不是全部,剩下的其实要看想象力了。

激光雷达并不仅仅有刚才说的作用。苹果在iPhone 12 Pro系列,iPad Pro上安装了激光雷达,等于突然把一个非常专业的能力,交给了全世界无数的用户。只要你买得起一个iPhone,你就可以拥有这种能力。

更重要的不是前面讲的东西,而是未来会不会有更多的玩法呢?这是我一直在思考的问题,这也是为什么今年我一定要买iPhone 12 Pro Max的一个最主要的原因。

我希望的是给大家一个启发,给开发者,给普通用户,给有想法的一些专业人士一些启发,了解到这个传感器是什么原理,可以做到什么样的效果,以及目前的应用在哪里。

但是我更想看到的更多人找到这么一个黑科技神器的更多用途。

举个例子,我们之前聊过很多特别大的商场下面的停车场就像一个迷宫,怎么都找不到出口。那么有了激光雷达,我们可以在下车以后,打开激光雷达,建立一个模型,然后走出停车场。那么这一路就形成了一个路径图和路径的3D模型。然后从之前的出口到商场以后,在回来的时候,根据这个路径图和3D模型就可以导航回来了。

等等,其实我自己有一个我觉得特别振奋人心的想法正在思考和准备开发,也许很快,我就能做一个Demo出来给大家看。这个东西做出来我可能会开源。

欢迎大家留言讨论。说说你对这个技术怎么看,谢谢。

因为文章体裁限制,一些Demo无法在文章中完美展现,如果想了解更多的信息也可以看我发表在Youtube上的视频。

微信扫一扫,打赏作者吧~

微信扫一扫,打赏作者吧~